Datenintegration in der Due Diligence – Vom Datensammeln zur konsistenten Entscheidungsgrundlage

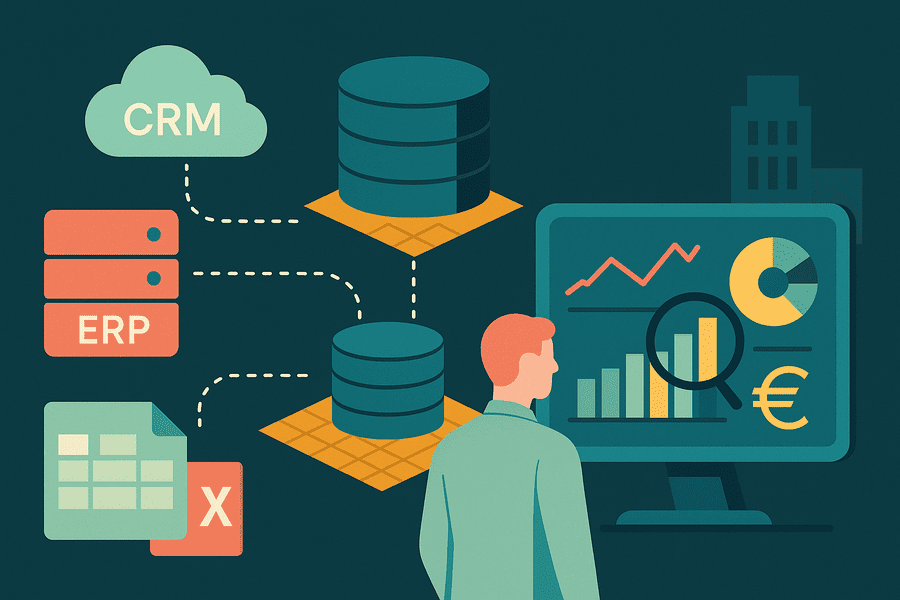

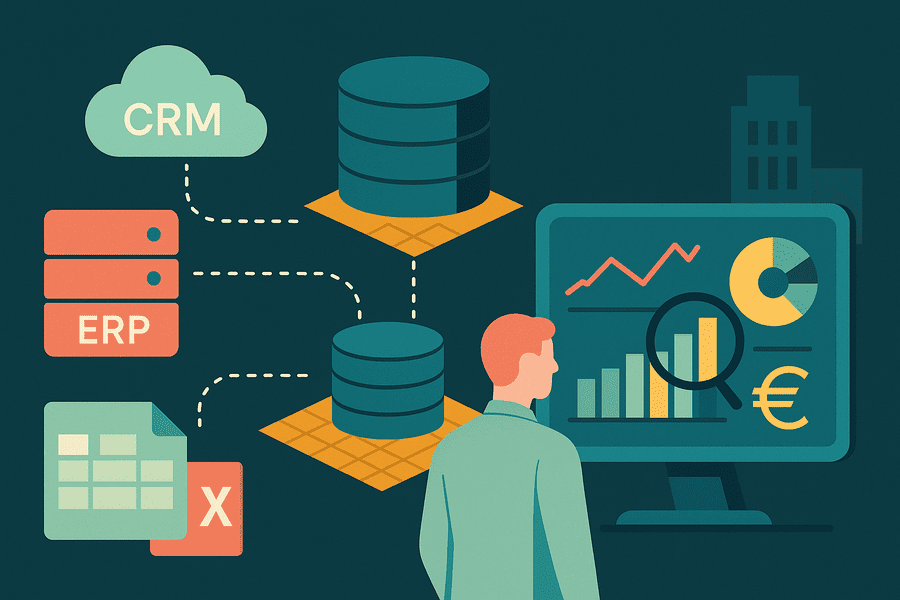

In vielen Due-Diligence-Projekten liegt die größte Herausforderung nicht in der Analyse, sondern in der konsistenten Integration verteilter Daten aus ERP, CRM und Excel. Eine pragmatische Datenintegration schafft Klarheit, reduziert Doppelarbeit und bildet die Grundlage für belastbare Entscheidungen.

Die Ausgangslage: Datenvielfalt ohne zentrale Struktur

In vielen Transaktionen zeigt sich ein ähnliches Bild: Das Target verfügt über verschiedene ERP-Instanzen, separates CRM oder Service-Ticketing, eigenständige Tools im Produktionsumfeld und eine Vielzahl an Excel-Dateien, die wichtige Informationen ergänzen oder ersetzen. Diese Vielfalt spiegelt die Historie des Unternehmens wider – etwa Zukäufe, gewachsene Strukturen oder begrenzte IT-Ressourcen.

Für die Due Diligence bedeutet das in der Praxis, dass es keine zentrale Datenquelle gibt. Informationen liegen verteilt, redundant oder in unterschiedlichen Aggregationsstufen vor. Dadurch verschiebt sich der Aufwand von der eigentlichen Analyse hin zur mühsamen Beschaffung, Bereinigung und Strukturierung von Daten – Zeit, die in kritischen Transaktionsprozessen kostbar ist.

Minimal-Architektur einer pragmatischen Datenintegration

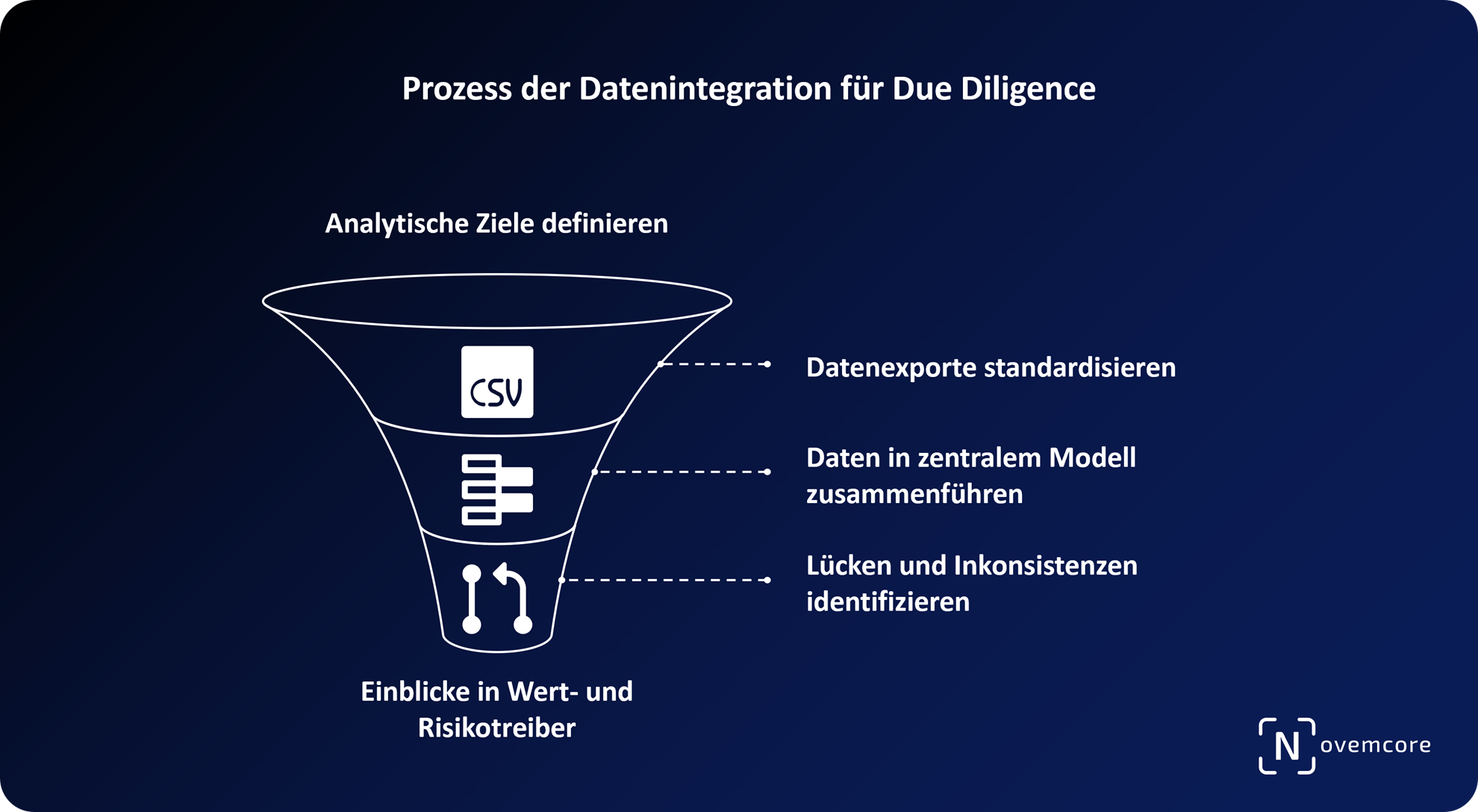

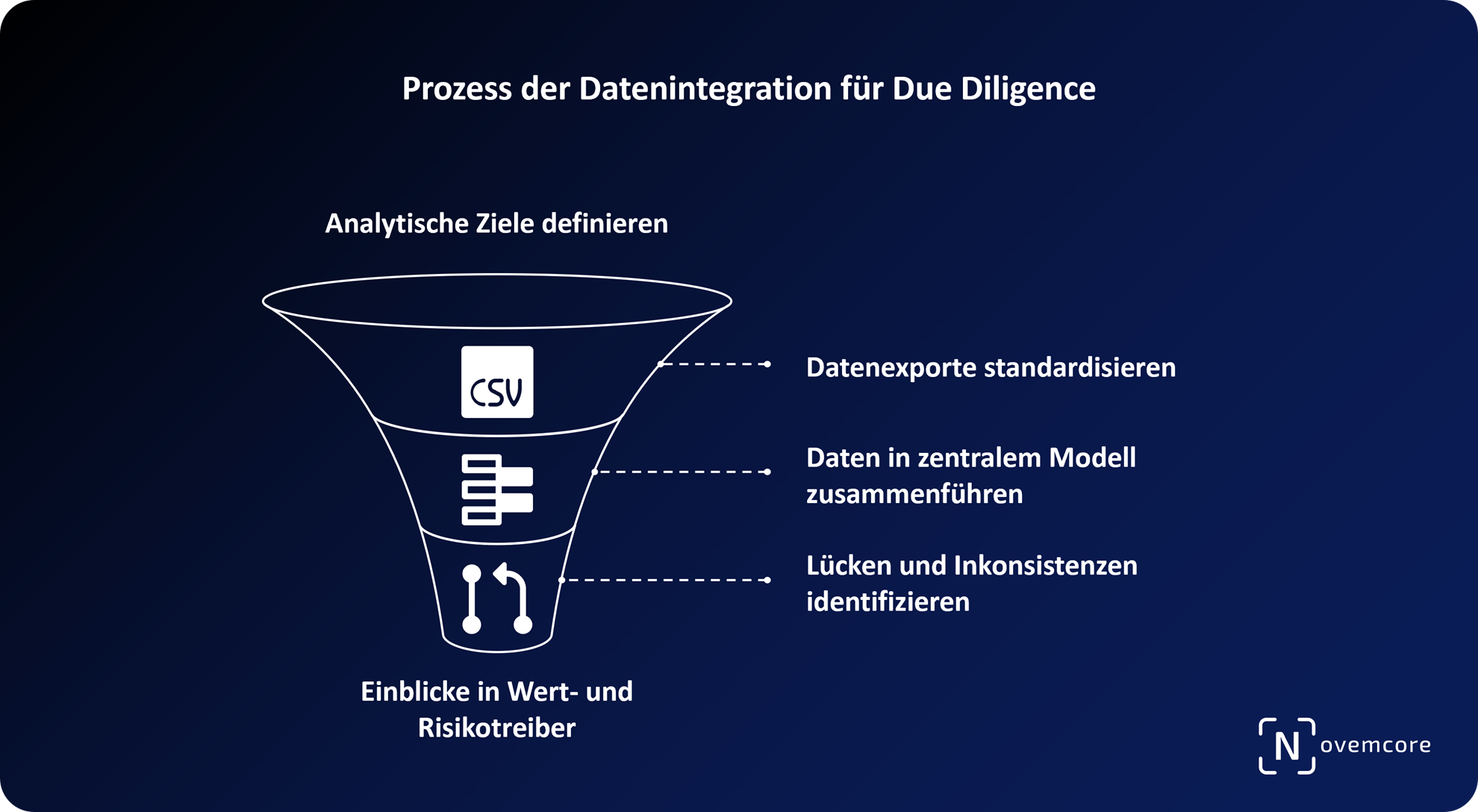

Das Ziel einer Due-Diligence-Datenintegration ist nicht der Aufbau einer perfekten Zielarchitektur, sondern die Schaffung einer temporären, zuverlässigen Integrationsschicht, die über Systemgrenzen hinweg konsistente Analysen ermöglicht. Die Grundfrage lautet: „Welche Informationen benötige ich wirklich, um die Wert- und Risikotreiber zu beurteilen?“

Im ersten Schritt wird das analytische Zielbild definiert: Welche Kennzahlen, Dimensionen und Auswertungen werden benötigt? Typische Beispiele sind Umsatz- und Margenanalysen, Working-Capital-Strukturen oder Kunden- und Lieferantenportfolios. Darauf aufbauend werden standardisierte Datenexporte vereinbart – klar definiert nach Feldern, Zeiträumen und Aggregationsstufen. Dieser Schritt reduziert Komplexität und schafft Vergleichbarkeit.

Alle Exporte werden anschließend in einem zentralen Datenmodell zusammengeführt. Dieses Modell muss nicht perfekt sein; entscheidend ist, dass es die geplanten Analysen trägt. Es definiert Schlüssel wie Kunden- oder Produkt-IDs und sorgt für eine einheitliche Grundlage. Während der Integration werden Lücken und Inkonsistenzen sichtbar – ein Befund, der selbst ein wichtiges Element der Due Diligence darstellt, weil er Aufschluss über Prozess- und Datenreife gibt.

Effizienzgewinne durch eine saubere Integrationsschicht

Eine gut strukturierte Integrationsschicht wirkt weit über die technische Ebene hinaus. Sie ermöglicht es Workstreams, auf denselben Zahlen zu arbeiten, statt parallel eigene Excel-Modelle zu pflegen. Änderungen an Segmentierungen, Abgrenzungslogiken oder KPIs werden zentral vorgenommen und spiegeln sich automatisch in allen Auswertungen wider. Dadurch fokussieren Diskussionen sich stärker auf Inhalte statt auf Zahlenabweichungen.

Ein Praxisbeispiel verdeutlicht dies: In einem Industrieprojekt mit mehreren internationalen Werken wurden anfangs pro Werk separate Auswertungen erstellt – mit unterschiedlichen Definitionen, Segmenten und Margenlogiken. Erst die zentrale Integration auf Kunden- und Produktebene ermöglichte eine konsistente Sicht auf globale Margen, Top-Kunden und Synergiepotenziale. Die Analyse wurde dadurch nicht nur schneller, sondern qualitativ belastbarer.

Datenintegration als Brücke in die Post-Merger-Phase

Ein oft unterschätzter Mehrwert liegt darin, dass die in der Due Diligence aufgebaute Integrationslogik auch nach Closing nutzbar ist. Sie dient als Blaupause für ein konsolidiertes Management-Reporting, unterstützt das Synergie-Tracking und bietet Orientierung für die spätere Harmonisierung von IT-Systemen.

Gerade in Plattformstrategien oder bei komplexen Corporate-Transaktionen ist dieser Übergang entscheidend: Wer die Datenintegration in der Due Diligence als isolierten Arbeitsschritt betrachtet, verschenkt Potenzial und schafft unnötige Doppelarbeit nach Closing.

Pragmatische Vorgehensweisen statt Perfektionismus

Der Anspruch in einer Due Diligence muss realistisch bleiben. Ziel ist nicht die nachhaltige Modernisierung der gesamten IT-Landschaft, sondern die Schaffung einer robusten Grundlage für die Bewertung der Wert- und Risikotreiber. Das bedeutet: wenige, klar strukturierte Exporte statt überkomplexer Datenabzüge; Fokus auf zentrale Entities wie Kunden, Produkte oder Gesellschaften statt auf jedes Detail; und Transparenz über fehlende oder inkonsistente Daten, statt diese stillschweigend zu korrigieren.

Ein pragmatischer Ansatz führt zu besseren Ergebnissen – analytisch und organisatorisch.

Fazit

Datenintegration ist ein kritischer, oft unterschätzter Erfolgsfaktor in der Due Diligence. Sie entscheidet darüber, ob Teams Zeit mit Kopieren und Abstimmen verbringen oder mit echter Bewertung und Interpretation. Zwischen ERP, CRM und Excel-Wüste schafft sie die Grundlage für konsistente, belastbare Analysen – und legt gleichzeitig die Basis für effiziente Wertschöpfung nach Closing. Wer sie ernst nimmt, stärkt die Qualität der Due Diligence und die Geschwindigkeit des gesamten Transaktionsprozesses.

Häufige Fragen (FAQ)

1. Warum ist Datenintegration in der Due Diligence so aufwändig?Weil viele Targets heterogene, historisch gewachsene Systemlandschaften haben, in denen es keine zentrale Datenbasis gibt.

2. Muss in der Due Diligence eine perfekte Datenarchitektur aufgebaut werden?Nein. Ziel ist eine pragmatische, temporäre Integrationsschicht, die konsistente Analysen ermöglicht.

3. Welche Vorteile bringt eine zentrale Integrationsschicht?Sie schafft eine einheitliche Datenbasis für alle Workstreams, reduziert Doppelarbeit und erhöht die Qualität der Analysen.

4. Wie hängt Datenintegration mit der Post-Merger-Integration zusammen?Die in der DD geschaffene Logik kann direkt für Reporting, Synergie-Tracking und IT-Harmonisierung genutzt werden.

5. Welche pragmatischen Prinzipien sollten Teams beachten?Fokus auf wesentliche Entities, wenige klar definierte Exporte und volle Transparenz über Lücken und Inkonsistenzen.

Datenintegration in der Due Diligence – Vom Datensammeln zur konsistenten Entscheidungsgrundlage

In vielen Due-Diligence-Projekten liegt die größte Herausforderung nicht in der Analyse, sondern in der konsistenten Integration verteilter Daten aus ERP, CRM und Excel. Eine pragmatische Datenintegration schafft Klarheit, reduziert Doppelarbeit und bildet die Grundlage für belastbare Entscheidungen.

Die Ausgangslage: Datenvielfalt ohne zentrale Struktur

In vielen Transaktionen zeigt sich ein ähnliches Bild: Das Target verfügt über verschiedene ERP-Instanzen, separates CRM oder Service-Ticketing, eigenständige Tools im Produktionsumfeld und eine Vielzahl an Excel-Dateien, die wichtige Informationen ergänzen oder ersetzen. Diese Vielfalt spiegelt die Historie des Unternehmens wider – etwa Zukäufe, gewachsene Strukturen oder begrenzte IT-Ressourcen.

Für die Due Diligence bedeutet das in der Praxis, dass es keine zentrale Datenquelle gibt. Informationen liegen verteilt, redundant oder in unterschiedlichen Aggregationsstufen vor. Dadurch verschiebt sich der Aufwand von der eigentlichen Analyse hin zur mühsamen Beschaffung, Bereinigung und Strukturierung von Daten – Zeit, die in kritischen Transaktionsprozessen kostbar ist.

Minimal-Architektur einer pragmatischen Datenintegration

Das Ziel einer Due-Diligence-Datenintegration ist nicht der Aufbau einer perfekten Zielarchitektur, sondern die Schaffung einer temporären, zuverlässigen Integrationsschicht, die über Systemgrenzen hinweg konsistente Analysen ermöglicht. Die Grundfrage lautet: „Welche Informationen benötige ich wirklich, um die Wert- und Risikotreiber zu beurteilen?“

Im ersten Schritt wird das analytische Zielbild definiert: Welche Kennzahlen, Dimensionen und Auswertungen werden benötigt? Typische Beispiele sind Umsatz- und Margenanalysen, Working-Capital-Strukturen oder Kunden- und Lieferantenportfolios. Darauf aufbauend werden standardisierte Datenexporte vereinbart – klar definiert nach Feldern, Zeiträumen und Aggregationsstufen. Dieser Schritt reduziert Komplexität und schafft Vergleichbarkeit.

Alle Exporte werden anschließend in einem zentralen Datenmodell zusammengeführt. Dieses Modell muss nicht perfekt sein; entscheidend ist, dass es die geplanten Analysen trägt. Es definiert Schlüssel wie Kunden- oder Produkt-IDs und sorgt für eine einheitliche Grundlage. Während der Integration werden Lücken und Inkonsistenzen sichtbar – ein Befund, der selbst ein wichtiges Element der Due Diligence darstellt, weil er Aufschluss über Prozess- und Datenreife gibt.

Effizienzgewinne durch eine saubere Integrationsschicht

Eine gut strukturierte Integrationsschicht wirkt weit über die technische Ebene hinaus. Sie ermöglicht es Workstreams, auf denselben Zahlen zu arbeiten, statt parallel eigene Excel-Modelle zu pflegen. Änderungen an Segmentierungen, Abgrenzungslogiken oder KPIs werden zentral vorgenommen und spiegeln sich automatisch in allen Auswertungen wider. Dadurch fokussieren Diskussionen sich stärker auf Inhalte statt auf Zahlenabweichungen.

Ein Praxisbeispiel verdeutlicht dies: In einem Industrieprojekt mit mehreren internationalen Werken wurden anfangs pro Werk separate Auswertungen erstellt – mit unterschiedlichen Definitionen, Segmenten und Margenlogiken. Erst die zentrale Integration auf Kunden- und Produktebene ermöglichte eine konsistente Sicht auf globale Margen, Top-Kunden und Synergiepotenziale. Die Analyse wurde dadurch nicht nur schneller, sondern qualitativ belastbarer.

Datenintegration als Brücke in die Post-Merger-Phase

Ein oft unterschätzter Mehrwert liegt darin, dass die in der Due Diligence aufgebaute Integrationslogik auch nach Closing nutzbar ist. Sie dient als Blaupause für ein konsolidiertes Management-Reporting, unterstützt das Synergie-Tracking und bietet Orientierung für die spätere Harmonisierung von IT-Systemen.

Gerade in Plattformstrategien oder bei komplexen Corporate-Transaktionen ist dieser Übergang entscheidend: Wer die Datenintegration in der Due Diligence als isolierten Arbeitsschritt betrachtet, verschenkt Potenzial und schafft unnötige Doppelarbeit nach Closing.

Pragmatische Vorgehensweisen statt Perfektionismus

Der Anspruch in einer Due Diligence muss realistisch bleiben. Ziel ist nicht die nachhaltige Modernisierung der gesamten IT-Landschaft, sondern die Schaffung einer robusten Grundlage für die Bewertung der Wert- und Risikotreiber. Das bedeutet: wenige, klar strukturierte Exporte statt überkomplexer Datenabzüge; Fokus auf zentrale Entities wie Kunden, Produkte oder Gesellschaften statt auf jedes Detail; und Transparenz über fehlende oder inkonsistente Daten, statt diese stillschweigend zu korrigieren.

Ein pragmatischer Ansatz führt zu besseren Ergebnissen – analytisch und organisatorisch.

Fazit

Datenintegration ist ein kritischer, oft unterschätzter Erfolgsfaktor in der Due Diligence. Sie entscheidet darüber, ob Teams Zeit mit Kopieren und Abstimmen verbringen oder mit echter Bewertung und Interpretation. Zwischen ERP, CRM und Excel-Wüste schafft sie die Grundlage für konsistente, belastbare Analysen – und legt gleichzeitig die Basis für effiziente Wertschöpfung nach Closing. Wer sie ernst nimmt, stärkt die Qualität der Due Diligence und die Geschwindigkeit des gesamten Transaktionsprozesses.

Häufige Fragen (FAQ)

1. Warum ist Datenintegration in der Due Diligence so aufwändig?Weil viele Targets heterogene, historisch gewachsene Systemlandschaften haben, in denen es keine zentrale Datenbasis gibt.

2. Muss in der Due Diligence eine perfekte Datenarchitektur aufgebaut werden?Nein. Ziel ist eine pragmatische, temporäre Integrationsschicht, die konsistente Analysen ermöglicht.

3. Welche Vorteile bringt eine zentrale Integrationsschicht?Sie schafft eine einheitliche Datenbasis für alle Workstreams, reduziert Doppelarbeit und erhöht die Qualität der Analysen.

4. Wie hängt Datenintegration mit der Post-Merger-Integration zusammen?Die in der DD geschaffene Logik kann direkt für Reporting, Synergie-Tracking und IT-Harmonisierung genutzt werden.

5. Welche pragmatischen Prinzipien sollten Teams beachten?Fokus auf wesentliche Entities, wenige klar definierte Exporte und volle Transparenz über Lücken und Inkonsistenzen.